Kogo dotyczy i co reguluje AI Act?

Chat GPT w ostatnim czasie mocno rozgrzał publiczną debatę nad przydatnością, zasadnością i bezpieczeństwem wykorzystania AI (artificial intelligence). W związku z nieustannym rozwojem i doskonaleniem sztucznej inteligencji konieczne jest możliwie szybkie uregulowanie tego obszaru. Próbę tę podjęła Unia Europejska, która w opisanym poniżej rozporządzeniu (AI Act) próbuje wprowadzić sztuczną inteligencję w ramy prawne na poziomie europejskim.

Sztuczna inteligencja. Wyzwania przed Unią Europejską

Jeżeli chodzi o rozwój AI, to Europa pozostaje daleko w tyle za USA i Chinami, ale za to w ustalaniu zasad prawnych dla bezpiecznego korzystania z niej – wysuwa się na prowadzenie. Podobnie jak w przypadku RODO, Stary Kontynent ma szanse wkrótce stać się globalnym liderem regulacji na polu AI.

Prawdziwym wyzwaniem dla Unii Europejskiej będzie niewątpliwie znalezienie kompromisu między utrzymaniem wysokich standardów ochrony prywatności i bezpieczeństwa użytkowników struktur sztucznej inteligencji a stworzeniem odpowiednich warunków dla rozwoju innowacji.

Czym jest Artificial Intelligence Act i co reguluje ?

Artificial Intelligence Act to rozporządzenie Parlamentu Europejskiego i rady ustanawiające zharmonizowane przepisy dotyczące sztucznej inteligencji.

Projekt Artificial Intelligence Act jest odpowiedzią na wyraźne apele ze strony Parlamentu Europejskiego i Rady Europejskiej. Wielokrotnie wzywały one do podjęcia działań ustawodawczych w celu zapewnienia prawidłowego funkcjonowania rynku wewnętrznego AI, z którym związane są zarówno korzyści, jak i zagrożenia.

InfoSec - czyli bezpieczeństwo informacji. Dowiedz się więcej

Parlament Europejski przyjął AI Act

Jak czytamy na stronie rozporządzenia The AI Act:

Like the EU’s General Data Protection Regulation (GDPR) in 2018, the EU AI Act could become a global standard, determining to what extent AI has a positive rather than negative effect on your life wherever you may be. The EU’s AI regulation is already making waves internationally. In late September 2021, Brazil’s Congress passed a bill that creates a legal framework for artificial intelligence. It still needs to pass the country’s Senate.

Twórcy AI Act wierzą, że to rozporządzenie stanie się światowym standardem, tak samo, jak kiedyś standardem stało się RODO.

Systemy AI. Unijny rynek się zmieni

Rozporządzenie dotyczące sztucznej inteligencji ma na celu:

- zapewnienie, aby systemy AI wprowadzane do obrotu w Unii i znajdujące się w użyciu były bezpieczne i zgodne z obowiązującym prawem w obszarze praw podstawowych oraz z unijnymi wartościami;

- zapewnienie pewności prawa na potrzeby ułatwienia inwestycji i innowacji w dziedzinie sztucznej inteligencji;

- poprawę zarządzania i skuteczne egzekwowanie obowiązujących przepisów dotyczących praw podstawowych i wymogów bezpieczeństwa mających zastosowanie do systemów sztucznej inteligencji;

- ułatwienie rozwoju jednolitego rynku zgodnych z prawem, bezpiecznych i wiarygodnych zastosowań sztucznej inteligencji oraz zapobieganie fragmentacji rynku.

Jako przedmiot projektowanego AI Act zostały wskazane następujące elementy:

- zharmonizowane przepisy dotyczące wprowadzania do obrotu, oddawania do użytku oraz wykorzystywania systemów sztucznej inteligencji w Unii;

- zakazy dotyczące określonych praktyk w zakresie sztucznej inteligencji;

- szczególne wymogi dotyczące sztucznej inteligencji wysokiego ryzyka oraz obowiązki spoczywające na podmiotach będących operatorami takich systemów;

- zharmonizowane przepisy dotyczące przejrzystości w przypadku systemów sztucznej inteligencji przeznaczonych do wchodzenia w interakcję z osobami fizycznymi, systemów rozpoznawania emocji oraz systemów kategoryzacji biometrycznej. Dotyczy to także AI wykorzystywanych do generowania obrazów, treści dźwiękowych lub treści wideo, lub do manipulowania nimi;

- przepisy dotyczące monitorowania po wprowadzeniu do obrotu i nadzorowania rynku.

Cyberstalking i stalking — kiedy jest naruszana nasza prywatność?

AI Act. Ocena poziomu ryzyka i zakazane działania

Europosłowie i europosłanki pracujący w komisjach rynku wewnętrznego – Internal Market Commitee (IMCO) rozszerzyli listę zakazanych działań, do których można wykorzystać sztuczną inteligencję. Wśród nich znalazły się:

- wprowadzanie do obrotu, oddawanie do użytku lub wykorzystywanie systemu sztucznej inteligencji, który stosuje techniki podprogowe będące poza świadomością danej osoby. Celem takiego działania jest zniekształcenie zachowania tej osoby w sposób, który powoduje lub może powodować u niej, lub u innej osoby szkodę fizyczną lub psychiczną;

- wprowadzanie do obrotu, oddawanie do użytku lub wykorzystywanie systemu sztucznej inteligencji, który wykorzystuje dowolne słabości określonej grupy osób ze względu na ich wiek, niepełnosprawność ruchową lub zaburzenie psychiczne. Celem takiego działania jest zniekształcenie zachowania osoby należącej do tej grupy w sposób, który powoduje lub może powodować u tej osoby, lub u innej osoby szkodę fizyczną lub psychiczną;

- wprowadzanie do obrotu, oddawanie do użytku lub wykorzystywanie AI przez organy publiczne, lub w ich imieniu na potrzeby oceny, lub klasyfikacji wiarygodności osób fizycznych prowadzonej przez określony czas na podstawie ich zachowania społecznego, lub znanych bądź przewidywanych cech osobistych, lub cech osobowości. Prowadzi to do jednego lub obu z następujących skutków: krzywdzącego, lub niekorzystnego traktowania niektórych osób fizycznych lub całych ich grup w kontekstach społecznych, które nie są związane z kontekstami, w których pierwotnie wygenerowano lub zgromadzono dane oraz krzywdzącego, lub niekorzystnego traktowania niektórych osób fizycznych, lub całych ich grup, które jest nieuzasadnione lub nieproporcjonalne do ich zachowania społecznego, lub jego wagi.

- wykorzystywania metod zdalnej identyfikacji biometrycznej „w czasie rzeczywistym” w przestrzeni publicznej do celów egzekwowania prawa. Chyba że w zakresie, w jakim takie wykorzystanie jest absolutnie niezbędne do jednego z określonych w rozporządzeniu celów.

AI Act przegłosowany. Nadchodzi rewolucja w przepisach

Kogo dotyczą planowane regulacje w zakresie sztucznej inteligencji?

Rozporządzenie AI Act ma zastosowanie do:

- dostawców wprowadzających do obrotu lub oddających do użytku AI w Unii, niezależnie od tego, czy dostawcy ci mają siedzibę w Unii, czy w państwie trzecim;

- operatorów AI, którzy znajdują się w Unii;

- dostawców i operatorów AI, którzy znajdują się w państwie trzecim, jeżeli wyniki działania systemu są wykorzystywane w Unii.

3 rodzaje podmiotów uwzględnionych w AI Act:

Dostawca: osoba fizyczna lub prawna, organ publiczny, agencja lub inny podmiot, który opracowuje AI lub zleca jego opracowanie. Celem takiego działania jest wprowadzenie go do obrotu, lub oddanie go do użytku pod własną nazwą handlową, lub własnym znakiem towarowym – odpłatnie lub nieodpłatnie;

Drobny dostawca: mikroprzedsiębiorstwo lub małe przedsiębiorstwo w rozumieniu zalecenia Komisji Europejskiej 2003/361/WE z dnia 6 maja 2003 roku.

Operator sztucznej inteligencji: osoba fizyczna lub prawna, organ publiczny, agencja lub inny podmiot, który korzystają z AI pod swoją kontrolą. Wyjątkiem jest sytuacja, w której system sztucznej inteligencji jest wykorzystywany w ramach osobistej działalności pozazawodowej.

Kategorie ryzyka zastosowania sztucznej inteligencji

Projekt AI Act stosuje podejście oparte na analizie ryzyka, wprowadzając rozróżnienie między zastosowaniami AI, które stwarzają:

Minimalne ryzyko: jest to obecnie najszersza z kategorii. Mieści się w niej większość systemów sztucznej inteligencji (SI), które stosowane są w Unii Europejskiej.

Ograniczone ryzyko: odnosi się do popularnych teraz chatbotów. Użytkownicy (np. osoby fizyczne) powinni zyskać świadomość tego, że piszą z maszyną.

Wysokie ryzyko: w tej kategorii znajdują się technologie, które mają wyraźnie negatywny wpływ na bezpieczeństwo i chronione prawa podstawowe.

Niedopuszczalne ryzyko: w tej kategorii mieszczą się elementy, które są najbardziej niebezpieczne. Zaliczamy do niej np. scoring społeczny – chiński system monitorowania obywateli pod kątem zachowywania się zgodnie z obowiązującym prawem. Chodzi też o systemy pozwalające na wykorzystywanie szpiegowanie ludzi czy wykorzystanie ich danych wrażliwych, takich jak np. orientacja seksualna. Niedozwolone będą też systemy klasyfikujące osoby fizyczne na podstawie ich danych biometrycznych, w celu wyciągnięcia wniosków o określonych aspektach życia prywatnego (np. poglądów politycznych).

Bezpieczeństwo w sieci dla najmłodszych. Praktyczny poradnik dla rodziców dzieci z klas 1-3

Czym są systemy wysokiego ryzyka?

System sztucznej inteligencji uznaje się za system wysokiego ryzyka, jeżeli spełnione są oba poniższe warunki:

- system AI jest przeznaczony do wykorzystywania jako związany z bezpieczeństwem element produktu objętego unijnym prawodawstwem harmonizacyjnym wymienionym w załączniku II lub sam jest takim produktem;

- produkt, którego związanym z bezpieczeństwem elementem jest system sztucznej inteligencji, lub sam system sztucznej inteligencji jako produkt podlegają – na podstawie unijnego prawodawstwa harmonizacyjnego wymienionego w załączniku II – ocenie zgodności przeprowadzanej przez osobę trzecią w celu wprowadzenia tego produktu do obrotu lub oddania go do użytku.

Oprócz systemów sztucznej inteligencji wysokiego ryzyka, o których mowa powyżej, za systemy wysokiego ryzyka uznaje się również systemy AI, wspomnianych w załączniku III.

Załącznik II do AI Act zawiera wykaz unijnego prawodawstwa harmonizacyjnego opartego na nowych ramach prawnych.

Natomiast załącznik III zawiera wykaz obszarów, w których dany system sztucznej inteligencji uznawany jest za system wysokiego ryzyka. Wśród tych systemów zostały wskazane m.in. systemy:

- sztucznej inteligencji przeznaczone do stosowania w celu zdalnej identyfikacji biometrycznej osób fizycznych „w czasie rzeczywistym” i „post factum”;

- sztucznej inteligencji przeznaczone do stosowania w celu podejmowania decyzji o dostępie do instytucji edukacyjnych i instytucji szkolenia zawodowego lub nadawania osobom przydziału do tych instytucji;

- sztucznej inteligencji przeznaczone do stosowania jako związane z bezpieczeństwem elementy procesów zarządzania i obsługi ruchu drogowego oraz zaopatrzenia w wodę, gaz, ciepło i energię elektryczną;

- sztucznej inteligencji przeznaczone do wykorzystania w celu rekrutacji lub wyboru osób fizycznych, w szczególności w przypadku informowania o wakatach, selekcji lub filtrowania podań o pracę, oceny kandydatów w trakcie rozmów kwalifikacyjnych lub testów;

- sztucznej inteligencji przeznaczone do wykorzystania przez organy publiczne lub w imieniu organów publicznych w celu oceny kwalifikowalności osób fizycznych do świadczeń i usług publicznych, jak również w celu przyznawania, ograniczania, unieważniania lub żądania zwrotu takich świadczeń i usług;

- sztucznej inteligencji przeznaczone do wykorzystania przez organy ścigania w celu przeprowadzania indywidualnych ocen ryzyka w odniesieniu do osób fizycznych, aby ocenić niebezpieczeństwo popełnienia lub ponownego popełnienia przestępstwa przez osobę fizyczną, lub zagrożenia, na jakie narażone są potencjalne ofiary przestępstw;

- sztucznej inteligencji przeznaczone do wykorzystania przez właściwe organy publiczne jako poligrafy i podobne narzędzia lub w celu wykrywania stanu emocjonalnego osoby fizycznej;

- sztucznej inteligencji, które mają służyć organowi sądowemu pomocą w badaniu i interpretacji stanu faktycznego i przepisów prawa oraz w stosowaniu prawa do konkretnego stanu faktycznego.

Ochrona danych w branży motoryzacyjnej. Co to jest TISAX?

Sztuczna inteligencja a ochrona danych

Zależności w obszarze regulacyjnym AI oraz prawa ochrony danych osobowych nie są wskazane wprost w projektowanym rozporządzeniu.

Wyjątkiem jest odesłanie do RODO w przepisie regulującym obowiązki operatorów sztucznej inteligencji wysokiego ryzyka. Zobowiązuje on operatorów sztucznej inteligencji do korzystania z informacji przekazanych na podstawie zapisów dotyczących przejrzystości i udostępniania informacji użytkownikom, aby wywiązać się ze spoczywającego na nich obowiązku przeprowadzenia oceny skutków dla ochrony danych zgodnie z art. 35 RODO.

Rada Unii Europejskiej przyjęła nowe przepisy. Kiedy AI Act wejdzie w życie?

AI Act jest pilnie potrzebnym uregulowaniem, które pozwoli ująć w ramy prawne sztuczną inteligencję, a także zagwarantować prawo do prywatności, aby nasze dane oraz informacje nie były naruszane w związku z działaniem AI.

Regulacje zawarte w AI Act są przepisami niezbędnymi nie tylko dla naszej prywatności, ale również dla przedsiębiorców. Ma bezpośredni wpływ na rynek nowych technologii.

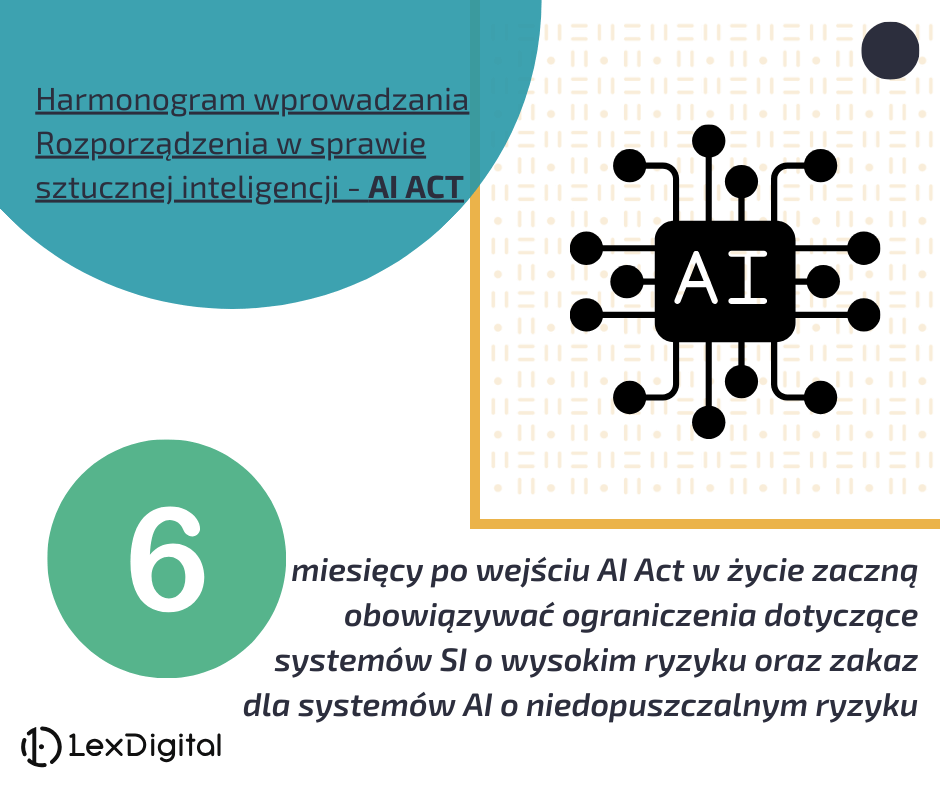

AI ACT został już przegłosowany. Wejdzie w życie dwadzieścia dni po publikacji w dzienniku urzędowym UE, co powinno nastąpić w najbliższych dniach. Zmiana będzie zachodzić stopniowo, a nowe prawo ma w pełni obowiązywać 24 miesiące po wejściu w życie. Jednak niektóre jego zapisy mają być przestrzegane wcześniej.

Zakaz systemów sztucznej inteligencji stwarzających niedopuszczalne ryzyko będzie obowiązywać sześć miesięcy po wejściu AI ACT w życie.

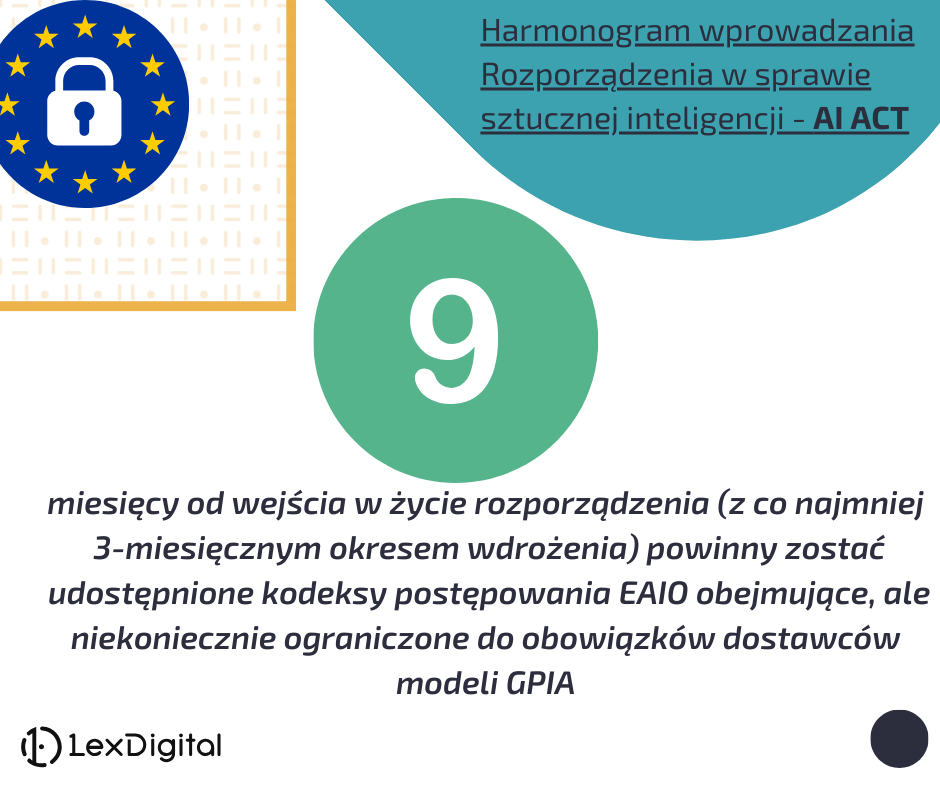

Z kolei po dziewięciu miesiącach po wejściu AI ACT w powinny zostać udostępnione kodeksy postępowania Europejskiego Biura ds Sztucznej Inteligencji [European AI Office]. Biuro będzie działać w ramach Komisji Europejskiej. Kodeksy będą obejmować obowiązki dostawców modeli sztucznej inteligencji ogólnego przeznaczenia [GPIA models].

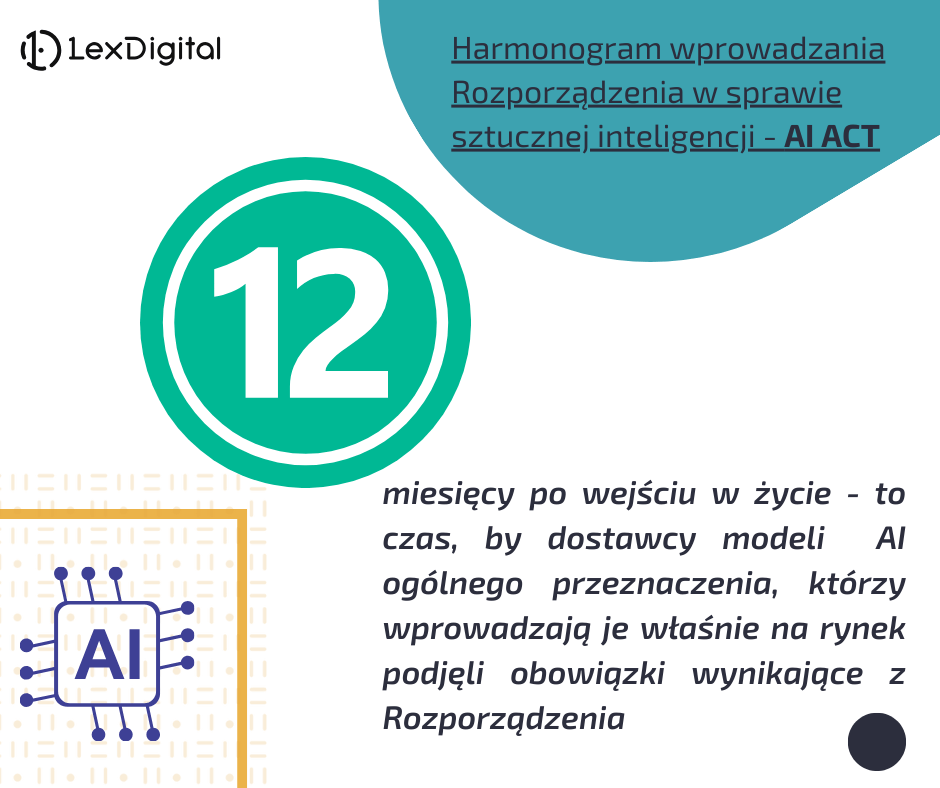

Ważny punkt harmonogramu to także 12 miesięcy po wprowadzeniu:

Więcej na temat AI Act przeczytasz w naszej analizie.